Когда Джон Бреннан, президент Обама, который был следующим главой ЦРУ, вчера предстал перед сенатским комитетом, один вопрос вытеснил всех остальных на его слушании о подтверждении:

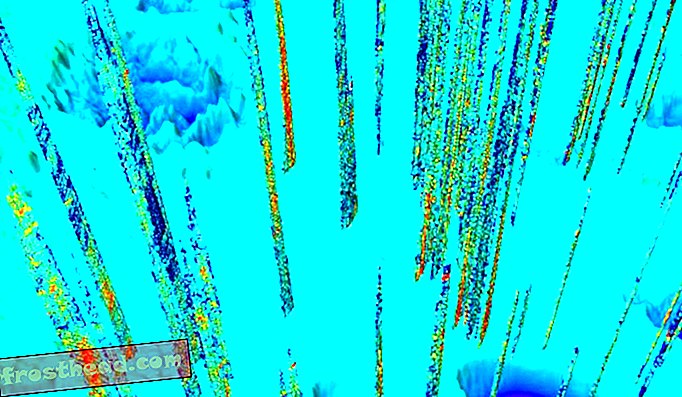

Как принимаются решения об отправке беспилотников после подозреваемых террористов?

Как и, если на то пошло, то почему заказывать конкретные удары дронов остается в значительной степени загадкой, но, по крайней мере, ясно одно - решения принимаются людьми, которые, как можно надеяться, борются с мыслью об отправке смертельной ракеты. в занятое здание.

Но что, если люди не были вовлечены? Что, если в один прекрасный день решения о жизни или смерти были оставлены на машинах, снабженных множеством данных, но также ощущением правильного и неправильного?

Моральное затруднение

Это не так далеко надумано. Это не произойдет в ближайшее время, но нет никаких сомнений в том, что по мере того, как машины становятся более интеллектуальными и более автономными, ключевой частью их трансформации будет способность изучать мораль.

На самом деле, это может быть не так далеко. Гари Маркус, пишущий недавно в The New Yorker, представил сценарий одной из машин без водителя Google, прежде чем был вынужден принять решение за доли секунды: «Ваша машина едет по мосту со скоростью 50 миль в час, когда заблудившийся школьный автобус перевозит 40 невинных детей пересекает свой путь. Должен ли ваш автомобиль свернуть, возможно, рискуя жизнью его владельца (вас), чтобы спасти детей, или продолжать движение, подвергая риску все 40 детей? Если решение должно быть принято за миллисекунды, компьютер должен будет сделать вызов ».

А как насчет роботизированного оружия или солдат? Сможет ли дрон научиться не стрелять по дому, если узнает, что невинные мирные жители тоже находятся внутри? Можно ли научить машины следовать международным правилам войны?

Рональд Аркин, профессор компьютерных наук и эксперт по робототехнике в Технологии Джорджии, наверняка так считает. Он разрабатывает программное обеспечение, называемое «этическим управляющим», которое позволит машинам решать, когда увольнять, а когда нет.

Аркин признает, что до этого еще могут пройти десятилетия, но он считает, что когда-нибудь роботы могут как физически, так и этически превзойти человеческих солдат, не уязвимых для эмоциональной травмы в бою или стремления к мести. Он не представляет армию, полностью состоящую из роботов, а такую, в которой машины обслуживают людей, выполняя высокорискованные работы, полные стрессовых быстрых решений, таких как расчистка зданий.

Остерегайтесь роботов-убийц

Но другие чувствуют, что пришло время раздавить этот тип мышления, прежде чем он заходит слишком далеко. В конце прошлого года Хьюман Райтс Вотч и правозащитная клиника Гарвардской школы права выпустили доклад «Потеря человечности: дело против роботов-убийц», в котором, как и следует его названию, содержится призыв к правительствам запретить любое автономное оружие, поскольку оно «увеличит риск смерти или ранения гражданских лиц во время вооруженного конфликта ».

Примерно в то же время группа профессоров Кембриджского университета объявила о планах запустить так называемый Центр изучения экзистенциального риска. Когда он откроется в конце этого года, он потребует серьезных научных исследований того, что может произойти, если и когда машины станут умнее нас.

Опасность, по словам Хью Прайса, одного из соучредителей Центра, заключается в том, что однажды мы могли бы иметь дело с «машинами, которые не являются вредоносными, но машинами, интересы которых не включают нас».

Искусство обмана

Shades of Skynet, мошенническая система искусственного интеллекта, которая породила киборга Арнольда Шварценеггера в фильмах «Терминатор» . Может быть, это всегда будет научной фантастикой.

Но рассмотрим другие исследования, которые Рональд Аркин сейчас делает в рамках проектов, финансируемых министерством обороны. Он и его коллеги изучали, как животные обманывают друг друга, с целью научить роботов искусству обмана.

Например, они работали над программированием роботов, чтобы при необходимости они могли симулировать силу, как это часто делают животные. И они смотрят на обучающие машины, чтобы имитировать поведение таких существ, как восточная серая белка. Белки прячут свои орехи от других животных, и, когда появляются другие белки или хищники, серые белки иногда посещают места, где раньше прятали орехи, чтобы сбить своих конкурентов с трассы. Роботы, запрограммированные на подобную стратегию, смогли сбить с толку и замедлить конкурентов.

Это все в интересах, говорит Аркин, разработки машин, которые не будут представлять угрозу для людей, а скорее являются преимуществом, особенно в безобразном хаосе войны. Ключ должен начать сосредотачиваться теперь на установке руководящих принципов для соответствующего поведения робота.

«Когда вы начнете открывать ящик Пандоры, что делать с этой новой возможностью?», - сказал он в недавнем интервью. «Я полагаю, что эти интеллектуальные роботы могут уменьшить потери среди некомбатантов, но мы должны быть очень осторожны с тем, как они используются, а не просто выпустить их на поле битвы без соответствующей заботы».

Чтобы верить нью-йоркскому писателю Гэри Маркусу, этически продвинутые машины предлагают огромный потенциал за пределами поля битвы.

Больше всего меня преследует мысль о том, что человеческая этика сама по себе является лишь незавершенной работой. Мы по-прежнему сталкиваемся с ситуациями, для которых у нас нет хорошо разработанных кодов (например, в случае вспомогательного самоубийства), и нам не нужно заглядывать в прошлое, чтобы найти случаи, когда наши собственные коды были сомнительными или хуже (например, законы, которые разрешено рабство и сегрегация).

То, что мы действительно хотим, - это машины, которые могут пойти еще дальше, наделенные не только самыми надежными этическими кодексами, которые могут разработать наши лучшие современные философы, но также и возможностью того, что машины добьются своего собственного морального прогресса, перенеся их за пределы нашего собственного ограниченного раннего развития. идея морали XXI века ».

Машины маршируют на

Вот более свежие разработки роботов:

- Хм, этично и подлый: исследователи в Австралии разработали робота, который может красться, двигаясь только при наличии достаточного количества фонового шума, чтобы скрыть его звук.

- Что это за гудение? Британские солдаты в Афганистане начали использовать беспилотники для наблюдения, которые могут поместиться в ладони. Названный Black Hornet Nano, маленький робот имеет длину всего четыре дюйма, но у него есть шпионская камера и он может летать в течение 30 минут при полной зарядке.

- Царапина на поверхности: НАСА разрабатывает робота по имени РАССОР, который весит всего 100 фунтов, но сможет добывать минералы на Луне и других планетах. Он может передвигаться по пересеченной местности и даже через смелые, опираясь на руки.

- Ах, похоть: И вот ранняя история Дня святого Валентина. Ученые из Токийского университета использовали робота-самца для управления роботом. Фактически, они использовали его спаривающие движения, чтобы направить устройство к объекту, ароматизированному феромонами женской моли.

Видео бонус: То есть вы просто не уверены, что сможете управлять роботом высотой 13 футов? Нет проблем. Вот отличная демонстрация, которая показывает, как легко это может быть. Удачливая модель даже показывает вам, как управлять функцией «Улыбка». Ты улыбаешься, это увольняет ВВ. Насколько это сложно?

Больше от Smithsonian.com

Этот робот лучше папы, чем твой папа

Роботы получают человеческое прикосновение